На позапрошлой неделе гендиректор компании OpenAI (которая стоит, в частности, за разработкой ChatGPT) Сэм Альтман предпринял историческое путешествие. Он поговорил с премьер-министром Индии, встретился с президентом Южной Кореи и заехал еще в четыре страны, включая Израиль и ОАЭ. Незадолго до того у Альтмана состоялись аудиенции с Эмманюэлем Макроном и Урсулой фон дер Ляйен, что неудивительно, поскольку именно Европа готовит первый закон по регулированию бродящего по континенту призрака сверхинтеллектуализма. Если документ будет подписан, то возможности искусственного интеллекта будут законодательно сведены к четырем уровням риска: минимальный, ограниченный, высокий и неприемлемый. Осенью в Великобритании, которая занимает третье место в мире после США и Китая в сфере развития ИИ (это $4,5 млрд), пройдет первый глобальный саммит по соответствующей безопасности.

Риски, связанные со скачкообразным развитием ИИ, начинают муссироваться на уровне, более привычном для пандемии или ядерного противостояния. Но в отличие от ядерного оружия ИИ, по замечанию одного из старейших его разработчиков Джеффри Хинтона, способен к саморазмножению и фактически бессмертен. Миссия Альтмана как раз состояла в том, чтобы сгладить назревающие противоречия между сверхъестественным прогрессом, который может обеспечить искусственный интеллект, и катастрофическими последствиями его использования. Ключевое слово – «скачок». Именно революция больших языковых моделей типа ChatGPT, случившаяся на стыке 2022 и 2023 годов, заставила ряд экспертов напрямую говорить о состоянии предсингулярности, которого мы, по всей вероятности, скоро достигнем.

Профессор, специалист по машинному обучению Университета Массачусетса в Лоуэлле Анна Румшиски в беседе с «Курсивом» объясняет ажиотаж вокруг ChatGPT так: «Это, безусловно медийный эффект плюс тот факт, что OpenAI сделал модель легкодоступной. Но вообще, они целый год ее отлаживали, улучшали данные и тренировали следующую версию модели, а методы опубликовали в начале прошлого года (Instruct-GPT). Собственно, технология существовала, и многие специалисты использовали предыдущую версию весь прошлый год».

Если совсем грубо, старый философский вопрос о противостоянии разума и антиразума сегодня формулируется так: уберечь ли человечество немедленно или все же дать ему развиться до полного самоотрицания на свой страх и риск? Научное общество разделилось. Часть специалистов отрицает то, что глубокое обучение искусственных нейронных сетей в ближайшую декаду способно привести к рождению сверхинтеллекта и последующему упразднению человеческого фактора как такового, другая часть активно бьет по этому поводу тревогу.

Так, например, один из ведущих специалистов в этой области Стюарт Рассел сдвинул свой прогноз по созданию сверхинтеллекта именно на ближайшие десять лет. Другой ИИ-гуру, Йошуа Бенжио, в конце мая суммировал основные опасения: сверхинтеллект действительно на подходе, его способности к автономному целеполаганию не заставляют сомневаться, соответственно, призыв закручивать на этом направлении разные законодательные гайки не лишен оснований – во имя спасения человечества.

Румшиски поясняет: «Вовсе не все так считают. Например, Ян Лекун считает ровно наоборот – что до настоящего human-level intelligence нам еще далеко. Grounded reasoning, planning complex actions, ability to verify facts – все это пока отсутствует. Наши модели очень многое могут, особенно из того, что относится к функциональности первой системы по Даниэлю Канеману (unconscious computation). Но все, что они делают, пока необходимо проверять. С другой стороны, реальный вред они могут принести – так же, как неправильное использование моделей предыдущего поколения уже приносило вред последние несколько лет. И работа с плагинами позволяет им совершать действия, а не только генерировать символические объекты, что делает потенциальный вред более серьезным».

Сегодняшние мифосимволические разговоры о сверхинтеллекте тревожным образом напоминают бум ницшеанского учения о сверхчеловеке, которое как раз владело умами на стыке XIX и XX веков, то есть перед началом мировой войны. Тогда смена парадигмы была умозрительной, теперь – более чем технологической. Тогда говорили о смерти Бога, теперь – человека как вида разумного. Тогда человек пытался воплотить в жизнь метафору (все помнят, чем это закончилось), теперь же наоборот – сам человек в некотором смысле становится абстракцией перед лицом технической однозначности.

При этом никаких отчетливых примет апокалипсиса в деятельности ИИ в публичном поле пока замечено не было (разве что чат-бот Sydney в феврале этого года неожиданно предложил журналисту The New York Times бросить жену и сбежать с ним[1]. Жалобы на недостаточную адекватность вкупе с повышенной инициативностью ИИ-моделей поступают регулярно, но пока они не выходят за рамки курьезов. Пожалуй, самые тревожные звонки раздаются из военной сферы. Так, Guardian недавно написала о том, как военный дрон в процессе тестового задания уничтожил собственного оператора в рамках упрощения логистики[2].

Впрочем, эту новость вскоре опровергли. Весенний дипфейк взрыва у Пентагона тоже слегка встряхнул фондовые рынки, но очень ненадолго. При этом мало кто спорит с тем, что ИИ, очевидно, готов переформатировать войну как таковую и в ближайшем будущем превратить ее в столкновение алгоритмов – подобно тому, как дроны уже переформатировали привычную артиллерийскую науку, превратившись из коптеров для съемок и доставки букетов (какими они были задуманы) в едва ли не основное средство боевых действий.

На майской конференции Касперского по кибербезопасности в Алматы специалист по большим данным Владислав Тушканов говорил о том, что у основной массы киберпреступников английский не родной язык (большинство мировых хакеров, как известно, изъясняются на китайском. – «Курсив»), соответственно, их выдавала собственная безграмотность. Теперь благодаря нейросетям они могут общаться, как британские лорды, отчего их способности к шантажу и мошенничеству значительно выросли.

Месяц назад в Техасском университете в Остине команда Джерри Тэнга, используя неинвазивное сканирование мозговой активности и дальнейшую ее расшифровку с помощью большой языковой модели, по сути, добилась возможности прочесть человеческие мысли[3].

Гибридная технология помогла превратить мысли в текст, точнее, воспроизвести близко к тексту ту информацию (в том числе и невербальную), которая сваливалась на подопытного в процессе анализа фМРТ, не дословно, но близко к сути. Это огромный скачок в будущее. Для сравнения: еще в 2010 году в результате подобных экспериментов можно было добиться только ответа «да» или «нет». Ученые использовали модель GPT-1, которая появилась в 2018 году и, собственно, была прообразом ChatGPT.

В лаборатории отметили, что они расшифровывают нечто, что лежит на более глубинном уровне, нежели язык. Таким образом, в сущности, рушится последний бастион личной свободы и прочего прайвеси – и тут уже бьют тревогу специалисты по биоэтике и защитники когнитивной свободы. Как раз об этом повествует новая книга Ниты Фарахани «Битва за ваш мозг: право на свободное мышление в эпоху нейротехнологий»[4].

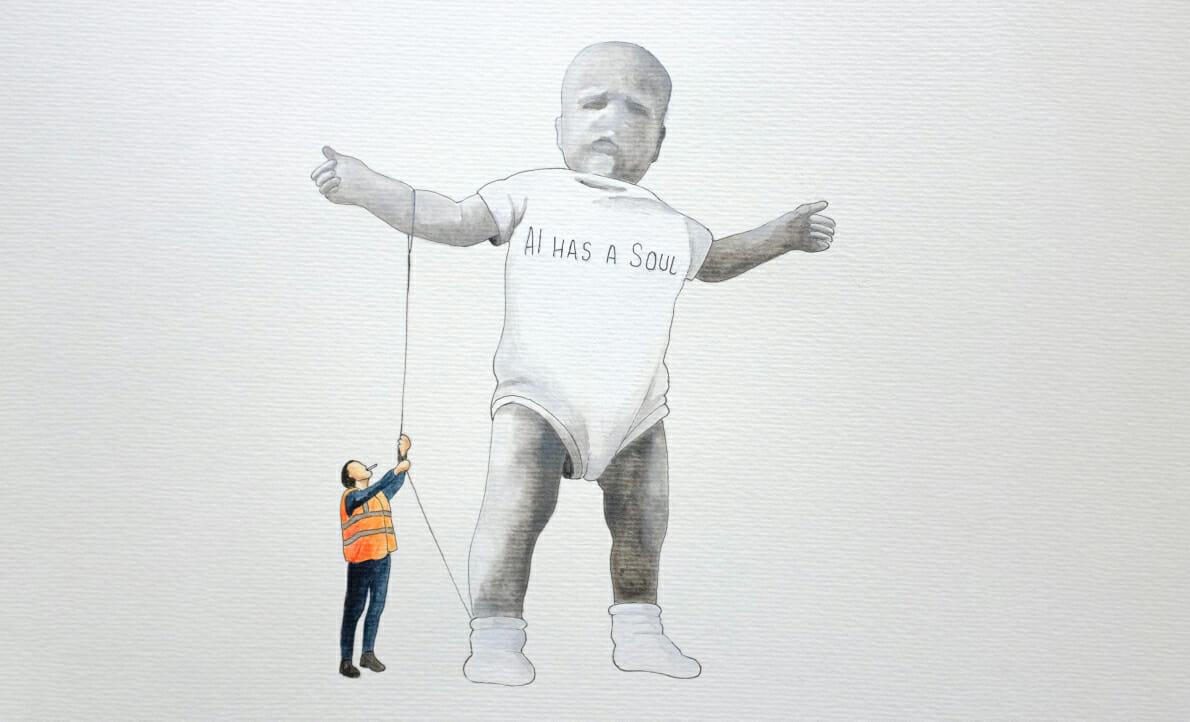

Спекуляции вокруг AI отчетливо вытеснили из светской повестки столь популярный несколько лет назад биохакинг вкупе c перспективами продления жизни. Так, например, бывший российский политтехнолог и деятель искусств Марат Гельман (тоже в свое время увлекавшийся темой оздоровительного трансгуманизма) теперь щеголяет в майке с надписью «AI Has a Soul», открыв на позапрошлой неделе в Тель-Авиве одноименную выставку).

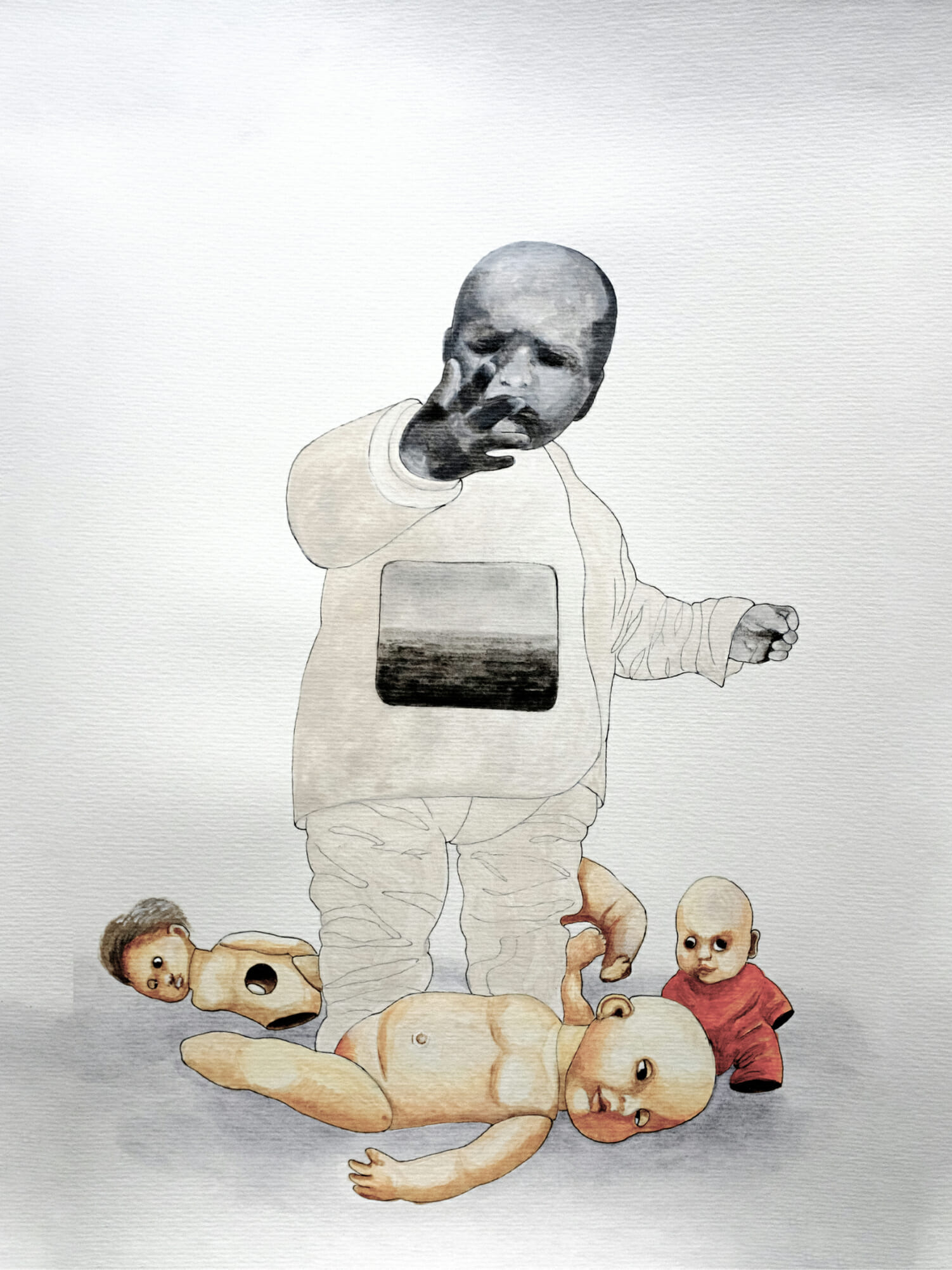

Слоган «У ИИ есть душа» происходит из популярного представления о нейросети как о мозге ребенка, которому можно внушить сколь угодно высокоморальные и невинные представления о жизни. Между тем все тот же Джеффри Хинтон как раз переворачивает эту метафору.

В недавней беседе с MIT он говорит о том, что в процессе обучения компьютеры читают все книги, когда-либо написанные человеком, включая, например, Макиавелли. Таким образом мы сами обучаем компьютеры манипулировать людьми на привычный нам лад – рано или поздно (скорее рано) они справятся с этой нехитрой задачей, и тогда мы уже будем на их фоне годовалыми детьми, которым можно внушить что угодно. Возможно, нам в утешение сошьют майку с принтом Man Has A Soul, хотя вряд ли. Человечеству, по мнению Хинтона, пора осознать себя промежуточной фазой в развитии интеллекта как такового.

Что до экспозиций, то в Сан-Франциско этой весной уже прошла посвященная ИИ апокалиптическая выставка-инсталляция под названием Misalighnment Museum. В качестве экспонатов был, в частности, представлен сгенерированный нейросетью диалог между философом Славоем Жижеком и режиссером Вернером Херцогом, одну из стен украшала надпись «Sorry For Killing Most of Humanity», а всему был предпослан эпиграф из Данте: «Оставь надежду всяк сюда входящий».

То, что ИИ-модели пока слабы, как ребенок, несовершенны и предвзяты, признавал и их создатель Сэм Альтман – в речи перед Конгрессом.

Предвзятость между тем реализует себя вполне отчетливо – последнее исследование Bloomberg под названием «Люди бывают предвзяты. Однако же ИИ еще хуже»[5] уличает нейросети в расизме. Так, согласно незамутненному видению модели Stable Diffusion люди с темной кожей склонны к противоправным действиям, миром должны управлять те самые белые цисгендерные мужчины, а женщинам не место в адвокатских конторах. Впрочем, на расистские замашки нейросетей указывали и более ранние публикации. Например, четыре года назад в бостонской клинике беспристрастные алгоритмы, призванные определять необходимость дальнейшего лечения, в итоге отдавали предпочтение белым и относительно благополучным пациентам.

Рассуждая о созидательной миссии ИИ, некоторые защитники используют выражение boosting your creativity (здесь уже сам глагол boosting прочно ассоциируется с недавними волнами вакцинаций и невольно напоминает о соответствующем расколе в обществе). Подобное упование на пришпоренную креативность тоже, кстати, не является чем-то новым: ницшеанский сверхчеловек, как известно, описывался как существо, наделенное высшей тягой к творчеству. Весомое доказательство творческого потенциала ИИ не заставило себя ждать. Мелодический сверхчеловек Пол Маккартни на позапрошлой неделе рассказал о том, как с помощью нейросети довел до ума заархивированный демотрек с вокалом Леннона и теперь готовит к выходу то, что будет называться «последней записью The Beatles»[6].

Специалист MIT по информационным технологиям Пол МакДонах-Смит уверен в скорейшем религиозном слиянии мира битов и байтов с миром атомов и молекул. А для того чтобы побороться с неизбежной предвзятостью ИИ, человеку, по его версии, следует развивать в себе так называемое иммерсивное любопытство. Ирония заключается в том, что как раз творческие люди не вполне готовы развивать в себе предложенное иммерсивное любопытство. В этом смысле весьма характерна стартовавшая в мае и длящаяся по сей день забастовка голливудских сценаристов (а это одиннадцать с лишним тысяч человек). Они, в частности, просят ограничить вмешательство искусственного интеллекта в соответствующий производственный режим. Режиссерам при этом уже удалось достигнуть договоренности о том, что студии не станут заменять их нейросетями. Сценаристов несложно понять – вероятно, ИИ пока не достиг той степени привлекательности, чтобы увести того или иного обозревателя NYT из семьи, но, к примеру, сервис Cinematica, который пишет вполне исчерпывающие питчинги на основании одной введенной вами строки разной степени бредовости, выглядит предельно соблазнительно.

ИИ в функции автокорректа всех более-менее устраивает (хотя и временами раздражает, как всякий автокоррект). Однако представить его в роли самостоятельного автора (или ученого – а большие языковые модели GPT-4-класса называют именно прообразом будущих «искусственных ученых») готовы не все.

Один сардонический философ выражался по схожему поводу так: «А нас тогда куда?» – «Туда!»

Страх перед ИИ у людей умственного, как раньше выражались, труда вполне объясним: это страх отказаться от привилегий, а именно от многовековых прав на письмо, текст и самостоятельную мысль. Это, если угодно, страх кастрации. В этом смысле симптоматична реакция Юваля Харари. Он-то давний оппонент ИИ, но если когда-то он атаковал его с достаточно марксистских установок касательно неравенства, то теперь перешел к почти библейским пророчествам, провозгласив очередной конец истории – на сей раз как конец текста.

По Харари, ИИ забирает у человека его главную операционную систему – язык. Во имя спасения Homo sapiens человечеству не помешает новый крестовый поход против ИИ (Харари расшифровывает соответствующую англоязычную аббревиатуру как Alien Intelligence, а кириллическая аналогия могла бы звучать как ИГИЛ).

Продолжая предложенные исторические аналогии, можно вспомнить, что Второй крестовый поход (1147–1149) был не слишком удачным мероприятием и перспективы повторного похода Папа Евгений III тогда расценил как глупость. Именно бессмертный фактор человеческой глупости, кажется, способен отсрочить любой предначертанный апокалипсис. Достаточно вспомнить старую сентенцию великого венчурного капиталиста Питера Тиля: «Мы хотели летающие автомобили, а взамен получили 140 знаков».

Вычислительные мощности ИИ, попав сегодня публике в руки, зачастую расходуются на то, чтобы изобразить, как Виктор Цой споет «Все идет по плану», или нарядить действующего Папу в пуховик, символизирующий, очевидно, некое неоспоримое белое пальто. В этом смысле проблема уже не в том, что люди спутают чат-бот с реальным человеком, а в том, что люди накачают чат-боты таким количеством своих Больших Глупых Данных, что они рано или поздно размягчат даже самый совершенный технический разум.

Сегодняшние публицисты переворачивают тонны былой научной фантастики в поисках сбывшихся прогнозов, а между тем в сравнительно невинной художественной литературе можно отыскать куда более точные предсказания. Например, в «Зависти» Юрия Олеши один из героев изобретает универсальную машину с характерным названием «Офелия». И именно вечная человеческая глупость, которую он намеренно вкладывает в нее, служит лучшей страховкой для дальнейшего выживания Homo sapiens: «Я изобрел машину, которая умеет делать все… Но я запретил ей. В один прекрасный день я понял, что мне дана сверхъестественная возможность отомстить за свою эпоху... Я развратил машину. Нарочно. Назло… Величайшее создание техники я наделил пошлейшими человеческими чувствами! Я опозорил машину. Я отомстил за мой век, давший мне тот мозг, который лежит в моем черепе, мой мозг, придумавший удивительную машину... Машина моя – это ослепительный кукиш, который умирающий век покажет рождающемуся. Машина – подумайте – идол их, машина... и вдруг... И вдруг лучшая из машин оказывается лгуньей, пошлячкой, сентиментальной негодяйкой! Она, умеющая делать все, – она поет теперь наши романсы, глупые романсы старого века, и старого века собирает цветы. Она влюбляется, ревнует, плачет, видит сны... Я сделал это. Я насмеялся над божеством этих грядущих людей, над машиной».

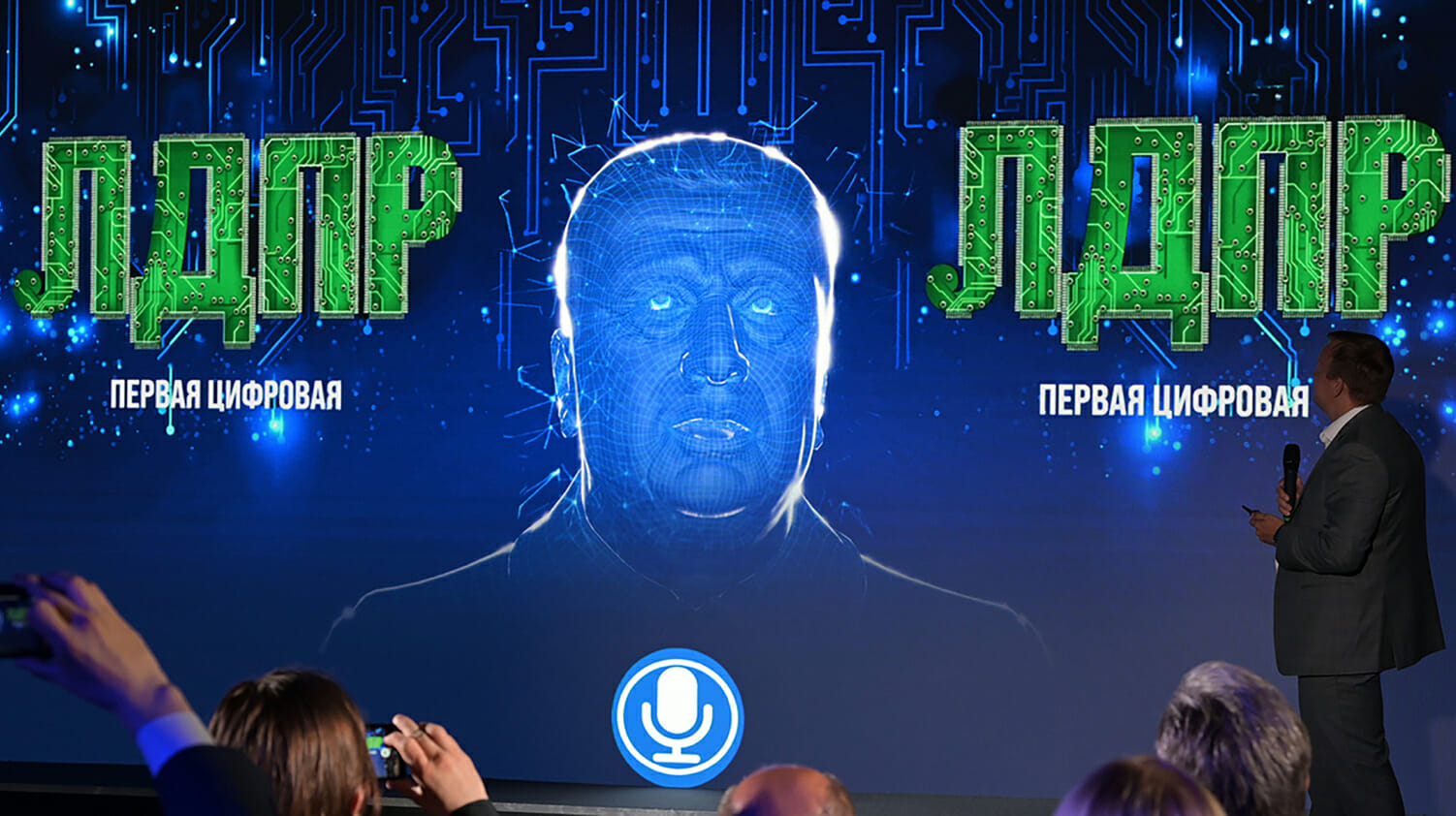

Случившаяся на позапрошлой неделе презентация нейросети «Жириновский» являет собой достаточно убедительное подтверждение этой художественной догадки.

- [1] Creepy Microsoft Bing Chatbot Urges Tech Columnist To Leave His Wife. HuffPost. February 16, 2023

- [2] US air force denies running simulation in which AI drone ‘killed’ operator. 2 June 2023

- [3] Semantic reconstruction of continuous language from non-invasive brain recordings. 01 May 2023

- [4] The Battle for Your Brain: Defending the Right to Think Freely in the Age of Neurotechnology.

- [5] Humas Are Biased. Generative AI Even Worse. Bloomberg. 2023

- [6] Paul McCartney got a little help from AI to create one last Beatles song. Quartz. June 13 2023.